Adityo GW

Saat ini saya bekerja sebagai freelance dan terlibat beberapa projek website serta pemeliharaan server.

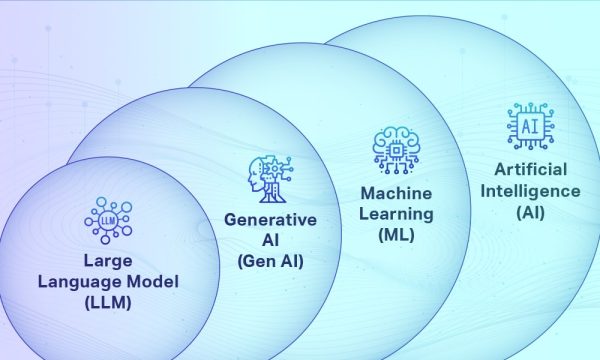

Large Language Model (LLM)

LLM lokal adalah model bahasa besar (seperti GPT) yang dijalankan langsung di komputer atau server kamu sendiri, bukan di server cloud seperti OpenAI. Dengan cara ini, semua proses pemrosesan teks dilakukan secara offline dan privat, tanpa mengirim data ke luar. Contoh model LLM lokal populer antara lain LLaMA 3, Mistral, Gemma, dan Qwen, yang bisa dijalankan menggunakan tool seperti Ollama atau LM Studio.

Apa itu Ollama? Ollama adalah aplikasi open source yang memungkinkan …

Bayangkan kamu punya sebuah sistem yang bisa membaca milyaran teks dari buku, artikel, forum, kode, website, dan lain-lain. Sistem ini “belajar” pola bahasa: struktur kalimat, kosakata, bagaimana konteks mempengaruhi makna, logika antar perkataan, hubungan kontekstual seperti “apa maksudnya kalau aku bilang … setelah …”. LLM (Large Language Model) adalah model neural network besar—biasanya arsitektur transformer—yang sudah dilatih (“pre-training”) dengan data sangat besar itu, sehingga bisa:

- Memahami pertanyaan atau instruksi dari manusia

- Menghasilkan teks baru (tulisan, dialog, kode) yang relevan dan sesuai konteks

Menyimpulkan, merangkum, menerjemahkan bahasa, menjawab pertanyaan, dan banyak tugas pemrosesan bahasa alami (NLP) lainnya

Setelah pre-training, biasanya LLM juga fine-tuned atau diberi instruksi khusus supaya lebih cocok untuk tugas tertentu: misalnya sebagai chatbot, penjawab teknis, penerjemah, asisten kode, dan lain-lain.

Beberapa aspek teknis penting:

- Parameter: bobot dalam jaringan. Lebih banyak parameter → lebih kapasitas model, tetapi juga butuh resource tinggi.

- Context window: seberapa panjang input (teks) yang bisa model “ingat” sekaligus. Semakin besar, semakin baik dalam menangani teks panjang, dialog panjang, dokumen, dsb.

- Multimodalitas: selain teks, beberapa model sekarang bisa juga menangani gambar, audio, dll.

- Safety / alignment: model perlu diatur agar tidak menghasilkan konten yang salah, berbahaya, bias, dll.

| Model | Tools | Kategori | Kegunaan |

|---|---|---|---|

LLaMA 3 8B–70B |

Meta / Ollama | General Reasoning | Model open-source kuat untuk reasoning, percakapan, dan coding. Stabil dijalankan di lokal. |

Mistral 7B 7B |

Mistral AI / Ollama | Compact LLM | Model efisien dan ringan, cocok untuk chatbot lokal dan text generation cepat. |

Mixtral 8x7B MoE (12B aktif) |

Mistral AI / Ollama | Mixture of Experts | Kombinasi model ringan dengan performa tinggi, unggul dalam analisis teks panjang. |

Gemma 2 2B–27B |

Google / Ollama | Multilingual | Model generatif fleksibel untuk teks dan percakapan multibahasa. |

Gemma 3 0.27B–27B |

Google / Ollama | Edge AI | Varian terbaru, lebih efisien dan cepat untuk perangkat lokal dan laptop. |

Phi-3 Medium 14B |

Microsoft / Ollama | Compact Assistant | Efisien untuk asisten pribadi, summarization, dan pemrograman ringan. |

Yi 1.5 6B–34B |

01.AI / Ollama | Multilingual | Cocok untuk aplikasi Asia multilingual dan proyek NLP bisnis. |

Qwen 2 1.5B–72B |

Alibaba / Ollama | Enterprise AI | Dipakai untuk analisis data, penulisan laporan, dan reasoning multilingual. |

Command-R+ 35B |

Cohere / Ollama | RAG Optimized | Dirancang untuk retrieval-augmented generation (RAG) dan chatbot internal. |

Zephyr 7B 7B |

Hugging Face / Ollama | Conversational | Model percakapan ringan untuk chatbot open source dan Q&A cepat. |

Vicuna 13B 13B |

LMSYS / Ollama | Chat Optimized | Fine-tuned dari LLaMA, hasil percakapan natural dan adaptif. |

Nous Hermes 2 7B |

Nous Research / Ollama | Conversational | Asisten gaya manusia untuk dialog natural dan role-based AI. |

DeepSeek Coder 7B–33B |

DeepSeek / Ollama | Code Generation | Fokus untuk generasi dan debugging kode otomatis multi-bahasa. |

WizardLM 2 7B–13B |

WizardLM / Ollama | Reasoning | Untuk tugas kompleks, penjelasan teknis, dan instruksi multi-langkah. |

StableLM 2 1.6B–12B |

Stability AI / Ollama | Creative Writing | Untuk pembuatan konten, teks kreatif, dan ide artistik. |

CodeLLaMA 7B–34B |

Meta / Ollama | Programming | Model coding populer untuk AI programmer dan IDE integrasi. |

SmolLM 135M–1.7B |

Hugging Face / Ollama | Micro LLM | Ultra ringan, cocok untuk chatbot mini di perangkat kecil. |

OpenChat 3.5 7B |

OpenChat / Ollama | General Chat | Fine-tuned untuk percakapan alami di berbagai konteks. |

TinyLLaMA 1.1B |

Meta / Ollama | Edge AI | Untuk eksperimen cepat dan perangkat berdaya rendah. |

Daftar Model LLM yang Dapat Dijalankan Secara Lokal di Ollama

Berikut daftar model Large Language Model (LLM) populer yang bisa kamu jalankan secara lokal melalui Ollama. Setiap model memiliki fokus dan ukuran yang berbeda sesuai kebutuhanmu — mulai dari percakapan, pemrograman, hingga penulisan kreatif.

Penjelasan Tambahan

Model LLM yang bisa dijalankan secara lokal (offline) di laptop melalui Ollama umumnya terbagi dalam 4 kategori utama:

| Kategori | Deskripsi | Contoh |

|---|---|---|

| General Reasoning | Fokus pada percakapan, pemahaman konteks, dan penalaran umum. | LLaMA 3, Mistral 7B, Mixtral 8x7B |

| Conversational | Dioptimalkan untuk percakapan alami dan interaktif. | Vicuna 13B, Zephyr 7B, Hermes 2 |

| Code Generation | Fokus pada pemrograman, debugging, dan instruksi teknis. | DeepSeek Coder, CodeLLaMA |

| Creative & Writing | Untuk ide, konten, teks kreatif, dan eksplorasi narasi. | StableLM 2, MythoMax |

| Tools / Platform | Deskripsi Singkat | Kelebihan Utama | Contoh Model yang Didukung |

|---|---|---|---|

| Ollama | Platform CLI sederhana untuk menjalankan LLM lokal berbasis container model. | Mudah digunakan, otomatis unduh & kelola model (1 perintah: ollama run llama3). |

LLaMA 2–3, Mistral, Gemma, Phi, DeepSeek, CodeLLaMA, dll. |

| LM Studio | Aplikasi GUI desktop (Windows/Mac/Linux) untuk menjalankan LLM lokal dengan antarmuka mirip ChatGPT. | Tampilan modern, mendukung model GGUF, integrasi Ollama backend. | LLaMA, Mistral, Gemma, Phi, Qwen, Zephyr, Vicuna. |

| KoboldCPP | Versi ringan dari KoboldAI berbasis C++, mendukung model GGUF & GGML. | Cepat di CPU, ringan, bisa pakai GPU opsional. | LLaMA, Mistral, MythoMax, Pygmalion, dll. |

| Text Generation WebUI | Web UI populer untuk local LLM, support banyak backend (transformers, exllama, llama.cpp). | Paling fleksibel, bisa load berbagai model open source. | LLaMA, Mistral, Falcon, WizardLM, Vicuna, dll. |

| GPT4All | GUI + CLI open source yang menyediakan model lokal siap unduh dari Nomic AI. | Tersedia model curated, cross-platform, ringan. | Mistral, LLaMA, Replit, Falcon, dll. |

| Jan.ai (Jan) | Aplikasi desktop lokal, mirip ChatGPT tapi offline sepenuhnya. | UI sangat simpel, terintegrasi Ollama & LM Studio. | LLaMA, Mistral, Phi, Gemma. |

| LMDeploy | Framework inference performa tinggi (GPU/CPU) untuk model LLM & VLM. | Optimasi performa enterprise-grade. | InternLM, Mistral, LLaMA. |

| ExLlama / ExLlamaV2 | Backend inference Python khusus model GGUF (GPU/RTX friendly). | Performa cepat, efisien VRAM, cocok untuk RTX mid-range. | LLaMA 2, MythoMax, Nous Hermes, dll. |

| Llama.cpp | Implementasi C++ resmi untuk menjalankan model LLaMA (dan turunannya) di CPU/GPU. | Basis dari banyak tools (Ollama, LM Studio, GPT4All). | Semua model GGUF: LLaMA, Mistral, Gemma, Phi. |

| KoboldAI | Web app lokal untuk storytelling, roleplay, dan creative writing. | Fokus di AI naratif / karakter. | MythoMax, Pygmalion, Chronos. |

| vLLM | Framework inference berperforma tinggi untuk skala server. | Cocok untuk multi-request & API lokal. | LLaMA, Qwen, Mixtral, Phi. |

| TextGen UI Docker | Versi container dari oobabooga untuk server & cloud pribadi. | Deployment cepat untuk multi user. | Semua model HF Transformers. |

| OpenWebUI | Antarmuka web open source untuk Ollama / LM Studio. | Bisa hubungkan banyak model & plugin. | Semua model Ollama + HuggingFace. |

| LocalAI | API server kompatibel OpenAI untuk LLM lokal (C++). | Bisa dipakai dengan API OpenAI-like apps. | LLaMA, Mistral, Phi, Gemma, Falcon. |